Verantwortungslos? (PhÜD): Unterschied zwischen den Versionen

Anna (Diskussion | Beiträge) (first) |

Anna (Diskussion | Beiträge) K (links) |

||

| (7 dazwischenliegende Versionen desselben Benutzers werden nicht angezeigt) | |||

| Zeile 1: | Zeile 1: | ||

| + | |||

| + | == [http://www.onr.navy.mil/Science-Technology/Departments/Code-34/All-Programs/human-bioengineered-systems-341.aspx Office of Naval Research. Human & Bioengineered Systems Division] == | ||

| + | |||

| + | === [http://archive.defense.gov/news/newsarticle.aspx?id=120329 Cost-saving Pilot Programs to Support Warfighter Autonomy] === | ||

| + | |||

| + | WASHINGTON, June 19, 2013 – A call from the Defense Department to government labs for autonomous technology ideas that support the warfighter has been answered with seven initiatives. | ||

| + | |||

| + | ... | ||

| + | |||

| + | “If we had better autonomous systems for route clearance in Afghanistan, we could offload a lot of the dangerous missions that humans undertake with autonomous systems, so we have to make a big push in autonomy," Shaffer said. | ||

| + | The pilot research initiative’s goal is to advance technologies that will result in autonomous systems that provide more capability to warfighters, lessen the cognitive load on operators and supervisors, and lower overall operational cost, explained Jennifer Elzea, a DOD spokeswoman. | ||

| + | |||

| + | ... | ||

| + | |||

| + | The seven projects are not looking at autonomous weapons systems, but rather are investigating autonomous systems for potential capabilities such as sensing and coordination among systems, Elzea noted. | ||

| + | |||

| + | ... | ||

| + | |||

| + | *Exploiting Priming Effects in Autonomous Cognitive Systems: Develops machine perception that is relatable to the way a human perceives an environment. (Navy Center for Applied Research in Artificial Intelligence, Army Research Laboratory) | ||

| + | *Autonomous Squad Member: Integrates machine semantic understanding, reasoning and understanding, perception into a ground robotic system. (Army Research Laboratory, Naval Research Laboratory, Navy Center for Applied Research in Artificial Intelligence) | ||

| + | *Autonomy for Adaptive Collaborative Sensing: Develops intelligent intelligence, surveillance and reconnaissance capability for sensing platforms to have capability to find and track targets. (Air Force Research Laboratory, Army Research Laboratory; Naval Research Laboratory) | ||

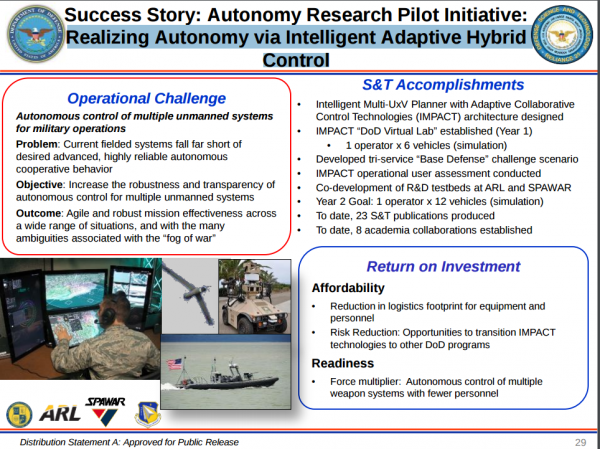

| + | *<font color="purple">Realizing Autonomy via Intelligent Adaptive Hybrid Control: Develops flexible unmanned aerial vehicle operator interface, enabling the operator to "call a play" or manually control the system. (Air Force Research Laboratory, Space and Naval Warfare Systems Command, Naval Research Laboratory, Army Research Laboratory)</font> | ||

| + | *Autonomy for Air Combat Missions, Mixed Human/Unmanned Aerial Vehicle Teams: Develops goal-directed reasoning, machine learning and operator interaction techniques to enable management of multiple team UAVs. (Air Force Research Laboratory, Naval Research Laboratory, Naval Air Warfare Center, Army Research Laboratory) | ||

| + | |||

| + | |||

| + | [http://www.defenseinnovationmarketplace.mil/resources/NDIA_Human_Systems_Conference_2016_HSCOI_DistroA_FINAL.pdf Human Systems Roadmap Review] | ||

| + | |||

| + | ::"Okay, but if you actually examine the document in question, it comes across as something a military-obsessed junior high school student would prepare for an art media project. | ||

| + | |||

| + | ::No self-respecting decision maker would take a document like that seriously. (Scotty Stone, May 13)" | ||

| + | |||

| + | <div align="center"> | ||

| + | [[Bild:Activehybrid.png| 600px]] | ||

| + | </div> | ||

| + | |||

| + | <br /> | ||

| + | |||

| + | [http://www.dtic.mil/ndia/2016Human/GregZacharias.pdf Greg Zacharias: Autonomous Horizons System Autonomy in the Air Force] | ||

| + | |||

| + | [http://www.dtic.mil/ndia/2015SET/WedBornstein.pdf Jon Bornstein: DoD Autonomy Roadmap Autonomy Community of Interest] | ||

| + | |||

| + | |||

| + | '''[https://medium.com/insurge-intelligence/the-pentagon-is-building-a-self-aware-killer-robot-army-fueled-by-social-media-bd1b55944298#.xyuavkyqx The Pentagon is building a ‘self-aware’ killer robot army fueled by social media]''' | ||

| + | |||

== Gewissenserforschung an Drohnen == | == Gewissenserforschung an Drohnen == | ||

| + | |||

| + | <br /> | ||

* [https://audiothek.philo.at/podcasts/mensch-sein-fundament-imperativ-oder-floskel/gewissenserforschung-an-drohnen-2 Kongress live] | * [https://audiothek.philo.at/podcasts/mensch-sein-fundament-imperativ-oder-floskel/gewissenserforschung-an-drohnen-2 Kongress live] | ||

* [http://philo.at/audioso/drohnen/ Kongress: Bild und Ton] | * [http://philo.at/audioso/drohnen/ Kongress: Bild und Ton] | ||

* [http://sammelpunkt.philo.at:8080/2522/ Kongresspublikation] | * [http://sammelpunkt.philo.at:8080/2522/ Kongresspublikation] | ||

| + | |||

| + | === Urteilskriterien. Eine Annäherung === | ||

| + | |||

| + | Es geht um den Unterschied moralisch qualifizierbarer Handlungen von Missgeschicken. Ein Kriterium, das dabei eine Rolle spielt, sei herausgegriffen. Der Unterschied liegt darin, ob eine Entschuldigung angezeigt ist. Genauer gesagt: In einem solchen Sprechakt verständigen sich zwei Akteure darüber, dass etwas nicht nach Wunsch verlaufen ist, dass eine Seite dazu den Anlass gab, dass dieser Vorgang die Gegenseite negativ betroffen hat und – darauf kommt es an – dass die Aktion nicht unvermeidlich, sondern (im Licht einer im Nachhinein angestellten Überprüfung), bedauerlich ist. Schlechtes Gewissen beruht dann darauf, aus einer Reihe von Optionen eine gewählt zu haben, die den selbstgesetzten Verhaltensstandards nicht genügt. Eine Entschuldigung zu akzeptieren bedeutet, der Kontrahentin „abzunehmen“, dass sie ihre Disposition umstellt. Dafür gibt es keine wissenschaftlichen Gesetzen vergleichbare Sicherheit, dennoch lassen sich Menschen immer wieder darauf ein. Und Drohnen? | ||

| + | |||

| + | Hier zeigt sich eine rekursive Schleife. Das Phänomen der Entschuldigung wurde herangezogen, um den Unterschied zwischen Handlung und Irrtum zu erfassen. Doch dieses Phänomen unterliegt denselben Bedenken. Weder können wir greifbar wissen, ob sich jemand bei einem Vorgang „etwas gedacht hat“, noch gibt es eine Garantie, dass seine Entschuldigung „ehrlich gemeint ist“. Untrüglichen Zeichen“, auf die man sich bisweilen beruft, sind ein Oxymoron. Im Begriff eines stellvertretenden Zeichens liegt nämlich, dass es in die Irre führen kann. Eine erfolgreiche Entschuldigung verlangt, dass sich die Kontrahenten im Interim zwischen ihren Handlungsdispositiven einigen. Die Rekursion geht weiter: worin besteht „Einigung“? Auf dem Gebiet der Handlungsanalyse ist dem intentionalen Vokabular nicht zu entkommen. Zur Beschreibung von Akteuren setzen wir zwei gegenstrebige, und dennoch in Verbindung funktionale, Mittel ein, die Eigen- und Fremdperspektive. Die Überlegung läuft auf die Frage hinaus, ob in der Rede vom schlechten Gewissen Drohnen als Vertreter der Fremdperspektive auftreten können. | ||

| + | |||

| + | „Können“ folgt hier der Grammatik von Ausdrücken für Kommunikationsregeln in sozialen Kontexten. In der Sache des schlechten Gewissens ist das eine Endstation. An ihr muss eine idealtypisch projizierte Bedeutung „vor Ort“ spezifisch umgesetzt werden. Gefragt ist, ob Drohnen eine gewisse Rolle spielen können. Aus den zahlreichen Varianten sprachlicher Rollenspiele wird eines herausgenommen, nämlich die Beschädigung von Menschen durch Maschinen. Zwei Eckpunkte der Analyse solcher Begebenheiten wurden festgestellt: der Handlungsbegriff und die Möglichkeit der Entschuldigung. In Bezug auf sie sind Weichen zu stellen. Erstens ist anzugeben, ob ein intentionales Vokabular am Platz ist, und zweitens, ob der Sprechakt der Entschuldigung unter den erwähnten Umständen ein angemessenes Unterscheidungskriterium ist. Wer das Vokabular ablehnt, gerät in eine für den Naturalismus charakteristische Position: Die Instrumente, die ihm zur Verfügung stehen, passen nach seiner Vorgabe nicht darauf, was abgelehnt wird. Eine solche Weichenstellung beseitigt das Problem. (Widersacher hängen für Naturalisten letztlich einem Aberglauben an.) Bleibt zu klären, was es mit der Option Entschuldigung auf sich hat. | ||

---- | ---- | ||

[[Category:Drohnen. SS 2016]] | [[Category:Drohnen. SS 2016]] | ||

Aktuelle Version vom 9. Juni 2016, 15:27 Uhr

Inhaltsverzeichnis

Cost-saving Pilot Programs to Support Warfighter Autonomy

WASHINGTON, June 19, 2013 – A call from the Defense Department to government labs for autonomous technology ideas that support the warfighter has been answered with seven initiatives.

...

“If we had better autonomous systems for route clearance in Afghanistan, we could offload a lot of the dangerous missions that humans undertake with autonomous systems, so we have to make a big push in autonomy," Shaffer said. The pilot research initiative’s goal is to advance technologies that will result in autonomous systems that provide more capability to warfighters, lessen the cognitive load on operators and supervisors, and lower overall operational cost, explained Jennifer Elzea, a DOD spokeswoman.

...

The seven projects are not looking at autonomous weapons systems, but rather are investigating autonomous systems for potential capabilities such as sensing and coordination among systems, Elzea noted.

...

- Exploiting Priming Effects in Autonomous Cognitive Systems: Develops machine perception that is relatable to the way a human perceives an environment. (Navy Center for Applied Research in Artificial Intelligence, Army Research Laboratory)

- Autonomous Squad Member: Integrates machine semantic understanding, reasoning and understanding, perception into a ground robotic system. (Army Research Laboratory, Naval Research Laboratory, Navy Center for Applied Research in Artificial Intelligence)

- Autonomy for Adaptive Collaborative Sensing: Develops intelligent intelligence, surveillance and reconnaissance capability for sensing platforms to have capability to find and track targets. (Air Force Research Laboratory, Army Research Laboratory; Naval Research Laboratory)

- Realizing Autonomy via Intelligent Adaptive Hybrid Control: Develops flexible unmanned aerial vehicle operator interface, enabling the operator to "call a play" or manually control the system. (Air Force Research Laboratory, Space and Naval Warfare Systems Command, Naval Research Laboratory, Army Research Laboratory)

- Autonomy for Air Combat Missions, Mixed Human/Unmanned Aerial Vehicle Teams: Develops goal-directed reasoning, machine learning and operator interaction techniques to enable management of multiple team UAVs. (Air Force Research Laboratory, Naval Research Laboratory, Naval Air Warfare Center, Army Research Laboratory)

- "Okay, but if you actually examine the document in question, it comes across as something a military-obsessed junior high school student would prepare for an art media project.

- No self-respecting decision maker would take a document like that seriously. (Scotty Stone, May 13)"

Greg Zacharias: Autonomous Horizons System Autonomy in the Air Force

Jon Bornstein: DoD Autonomy Roadmap Autonomy Community of Interest

The Pentagon is building a ‘self-aware’ killer robot army fueled by social media

Gewissenserforschung an Drohnen

Urteilskriterien. Eine Annäherung

Es geht um den Unterschied moralisch qualifizierbarer Handlungen von Missgeschicken. Ein Kriterium, das dabei eine Rolle spielt, sei herausgegriffen. Der Unterschied liegt darin, ob eine Entschuldigung angezeigt ist. Genauer gesagt: In einem solchen Sprechakt verständigen sich zwei Akteure darüber, dass etwas nicht nach Wunsch verlaufen ist, dass eine Seite dazu den Anlass gab, dass dieser Vorgang die Gegenseite negativ betroffen hat und – darauf kommt es an – dass die Aktion nicht unvermeidlich, sondern (im Licht einer im Nachhinein angestellten Überprüfung), bedauerlich ist. Schlechtes Gewissen beruht dann darauf, aus einer Reihe von Optionen eine gewählt zu haben, die den selbstgesetzten Verhaltensstandards nicht genügt. Eine Entschuldigung zu akzeptieren bedeutet, der Kontrahentin „abzunehmen“, dass sie ihre Disposition umstellt. Dafür gibt es keine wissenschaftlichen Gesetzen vergleichbare Sicherheit, dennoch lassen sich Menschen immer wieder darauf ein. Und Drohnen?

Hier zeigt sich eine rekursive Schleife. Das Phänomen der Entschuldigung wurde herangezogen, um den Unterschied zwischen Handlung und Irrtum zu erfassen. Doch dieses Phänomen unterliegt denselben Bedenken. Weder können wir greifbar wissen, ob sich jemand bei einem Vorgang „etwas gedacht hat“, noch gibt es eine Garantie, dass seine Entschuldigung „ehrlich gemeint ist“. Untrüglichen Zeichen“, auf die man sich bisweilen beruft, sind ein Oxymoron. Im Begriff eines stellvertretenden Zeichens liegt nämlich, dass es in die Irre führen kann. Eine erfolgreiche Entschuldigung verlangt, dass sich die Kontrahenten im Interim zwischen ihren Handlungsdispositiven einigen. Die Rekursion geht weiter: worin besteht „Einigung“? Auf dem Gebiet der Handlungsanalyse ist dem intentionalen Vokabular nicht zu entkommen. Zur Beschreibung von Akteuren setzen wir zwei gegenstrebige, und dennoch in Verbindung funktionale, Mittel ein, die Eigen- und Fremdperspektive. Die Überlegung läuft auf die Frage hinaus, ob in der Rede vom schlechten Gewissen Drohnen als Vertreter der Fremdperspektive auftreten können.

„Können“ folgt hier der Grammatik von Ausdrücken für Kommunikationsregeln in sozialen Kontexten. In der Sache des schlechten Gewissens ist das eine Endstation. An ihr muss eine idealtypisch projizierte Bedeutung „vor Ort“ spezifisch umgesetzt werden. Gefragt ist, ob Drohnen eine gewisse Rolle spielen können. Aus den zahlreichen Varianten sprachlicher Rollenspiele wird eines herausgenommen, nämlich die Beschädigung von Menschen durch Maschinen. Zwei Eckpunkte der Analyse solcher Begebenheiten wurden festgestellt: der Handlungsbegriff und die Möglichkeit der Entschuldigung. In Bezug auf sie sind Weichen zu stellen. Erstens ist anzugeben, ob ein intentionales Vokabular am Platz ist, und zweitens, ob der Sprechakt der Entschuldigung unter den erwähnten Umständen ein angemessenes Unterscheidungskriterium ist. Wer das Vokabular ablehnt, gerät in eine für den Naturalismus charakteristische Position: Die Instrumente, die ihm zur Verfügung stehen, passen nach seiner Vorgabe nicht darauf, was abgelehnt wird. Eine solche Weichenstellung beseitigt das Problem. (Widersacher hängen für Naturalisten letztlich einem Aberglauben an.) Bleibt zu klären, was es mit der Option Entschuldigung auf sich hat.